Seules 22 % des grandes entreprises ont vraiment sauté le pas dans leurs investissements, et les gains promis sont parfois très surestimés.

Entre les injonctions, les promesses des technophiles et la prudence des sceptiques, on va se poser et rassembler quelques faits. En 2024, 22 % des grandes entreprises avaient développé une intelligence artificielle générative à grande échelle. Soit, à peine une entreprise sur cinq avait réellement sauté le pas. Et au sujet des 10 % de productivité, pour l’économiste Dario Amodei du MIT, c’est largement surestimé.

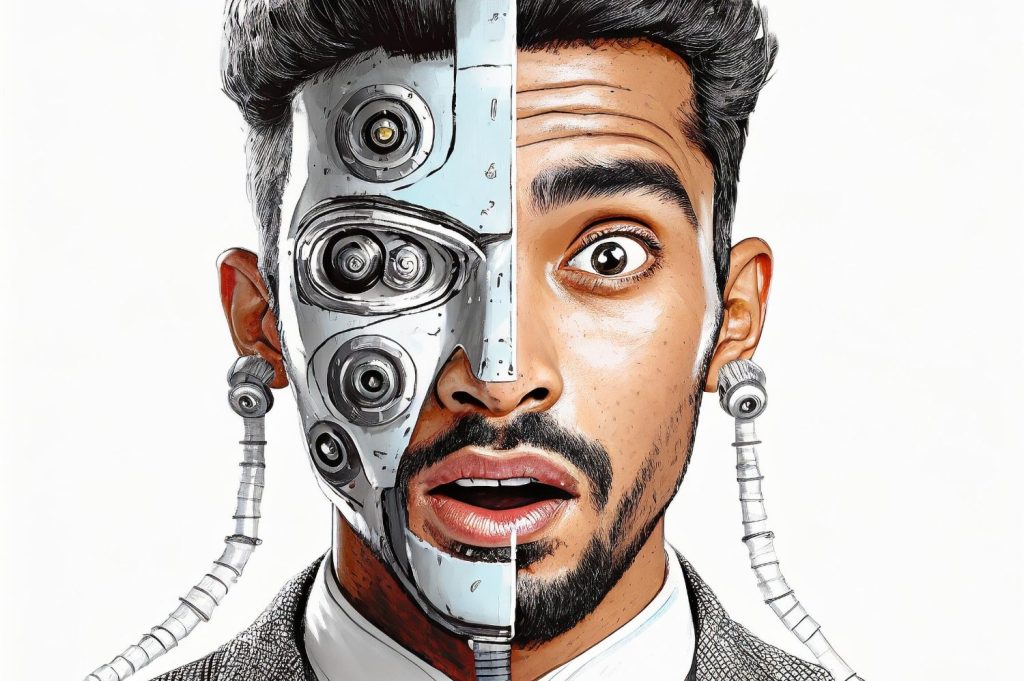

Et plutôt que la question : « Qui ? » a réellement développé une intelligence artificielle, ce serait : « comment ? »

Certaines études menées comme celle par Databrix, au niveau mondial, montre des gains réels dans les cabinets de conseil, les services juridiques ou encore chez les collaborateurs. À noter, ce sont les employés les moins productifs à la base, qui profitent le plus des premiers effets. En somme, plus le niveau de départ est bas, et plus l’intelligence artificielle booste !

Dans les grandes boîtes, l’intelligence artificielle est déployée pour des décisions stratégiques. Développement, produits, recrutement, planification RH. Et surtout, pour tout ce qui touche le client : marketing, vente, service, là, c’est le jackpot. Dans les entreprises qui pèsent plus de 10 milliards de dollars, 97 % utilisent déjà l’intelligence artificielle générative. Par exemple, dans une entreprise de service américaine, les employés accompagnés par un assistant IA productivité ont vu leur productivité grimper de 14 % en un mois, et de 25 % après trois mois. Sans surprise, les DSI sont logiquement les plus enthousiastes, 62 % l’ont déjà intégré totalement.

Et parmi les champions, citons le secteur financier. Chez BNP Paribas, pas moins de 780 cas d’usage d’intelligence artificielle étaient en production fin 2024. Leur recette ? apprentissage progressif, et montée en compétences. À l’inverse, la fonction juridique reste frileuse. La santé et le commerce de détail y vont doucement, tandis que le secteur public et les médias font de la résistance !

Et en France ? Là il n’y a pas de quoi être fier, selon Opinion Way, quatre entreprises sur dix n’ont encore rien fait. Plus de la moitié ont engagé des tests – parce que la tech, oui, c’est facile à tester, mais l’implémenter, c’est un sport de haut niveau !

Pendant ce temps, près d’un salarié sur deux reconnaît l’utiliser #ShadowAI , et un tiers tous les jours, sans pour autant en informer leur hiérarchie. Résultat : on injecte des données sensibles depuis des comptes personnels, sans cadre, sans gouvernance, ce qui pose des risques de sécurité, de fuites et d’éthique, pour ne citer que quelques uns. Comment réussir cette intégration dans les entreprises ?

Trois axes : la data, les process, les humains.

Premièrement, d’un point de vue technologique, primordial est le travail sur la donnée. Elle est trop fragmentée, mal gouvernée. 48 % des data-ingénieurs passent leur temps à réparer les connexions aux sources. L’architecture est à revoir, et la gouvernance souvent absente.

Deuxièmement, côté organisation, il faut écouter les métiers. Auditer les usages, intégrer l’intelligence artificielle aux processus réels. Et surtout, former. Déjà 93 % des dirigeants britanniques ont lancé des plans pour muscler les compétences en intelligence artificielle. Et quand c’est bien structuré, la productivité peut grimper de 30 %. Comme le dit Vincent Luciani, co-fondateur de la société Artefact, l’intelligence artificielle ne rapporte que si elle s’inscrit dans l’intelligence collective. Fun fact, pour conclure, les métiers les plus impactés par l’intelligence artificielle ne sont pas ceux que l’on croit.

Alors, devinette, qui sont les plus touchés ?

Les dirigeants et les managers ! Parce qu’aujourd’hui, l’intelligence artificielle peut révéler des modèles d’affaires inédits, des signaux faibles, et repenser la stratégie en profondeur. La vraie question pour les managers n’est plus de penser l’efficacité des collaborateurs, mais surtout, la leur !

A écouter, sur le podcast TrenchTech : https://b21-audiofiles.ausha.co/4DHIFWf9gq0ofhhbIXbnOByUAnVShShKwZKiZXxy.mp3?token=1769779302-ga3bymLmKO1zSKI8tPbuCIQ2IfZZMULOx2NMMcXxdeo%3D